GLM-5 来了:智谱新旗舰,剑指 Agentic Engineering

从"写代码"到"写工程",大模型正式进入 Agent 时代。

一、GLM-5 是什么?

GLM-5 是智谱AI新一代的旗舰基座模型,面向 Agentic Engineering 打造,能够在复杂系统工程与长程 Agent 任务中提供可靠生产力。

在 Coding 与 Agent 能力上,GLM-5 取得开源 SOTA 表现,在真实编程场景的使用体感逼近 Claude Opus 4.5,擅长复杂系统工程与长程 Agent 任务,是通用 Agent 助手的理想基座。

核心参数一览

| 项目 | 规格 |

|---|---|

| 定位 | 旗舰基座模型 |

| 输入/输出模态 | 文本 → 文本 |

| 参数规模 | 744B(激活 40B) |

| 预训练数据 | 28.5T |

| 上下文窗口 | 200K tokens |

| 最大输出 | 128K tokens |

二、更大基座,更强智能

GLM-5 全新基座为从"写代码"到"写工程"的能力演进提供了坚实基础:

1. 参数规模大幅扩展

从 GLM-4 系列的 355B(激活 32B) 扩展至 744B(激活 40B),预训练数据从 23T 提升至 28.5T。更大规模的预训练算力,显著提升了模型的通用智能水平。

2. 异步强化学习

构建全新的 "Slime" 框架,支持更大模型规模及更复杂的强化学习任务。提出异步智能体强化学习算法,使模型能够持续从长程交互中学习,充分激发预训练模型的潜力。

3. 稀疏注意力机制

首次集成 DeepSeek Sparse Attention,在维持长文本效果无损的同时,大幅降低模型部署成本,提升 Token Efficiency。

三、Coding 能力:对齐 Claude Opus 4.5

这或许是 GLM-5 最令人兴奋的部分。

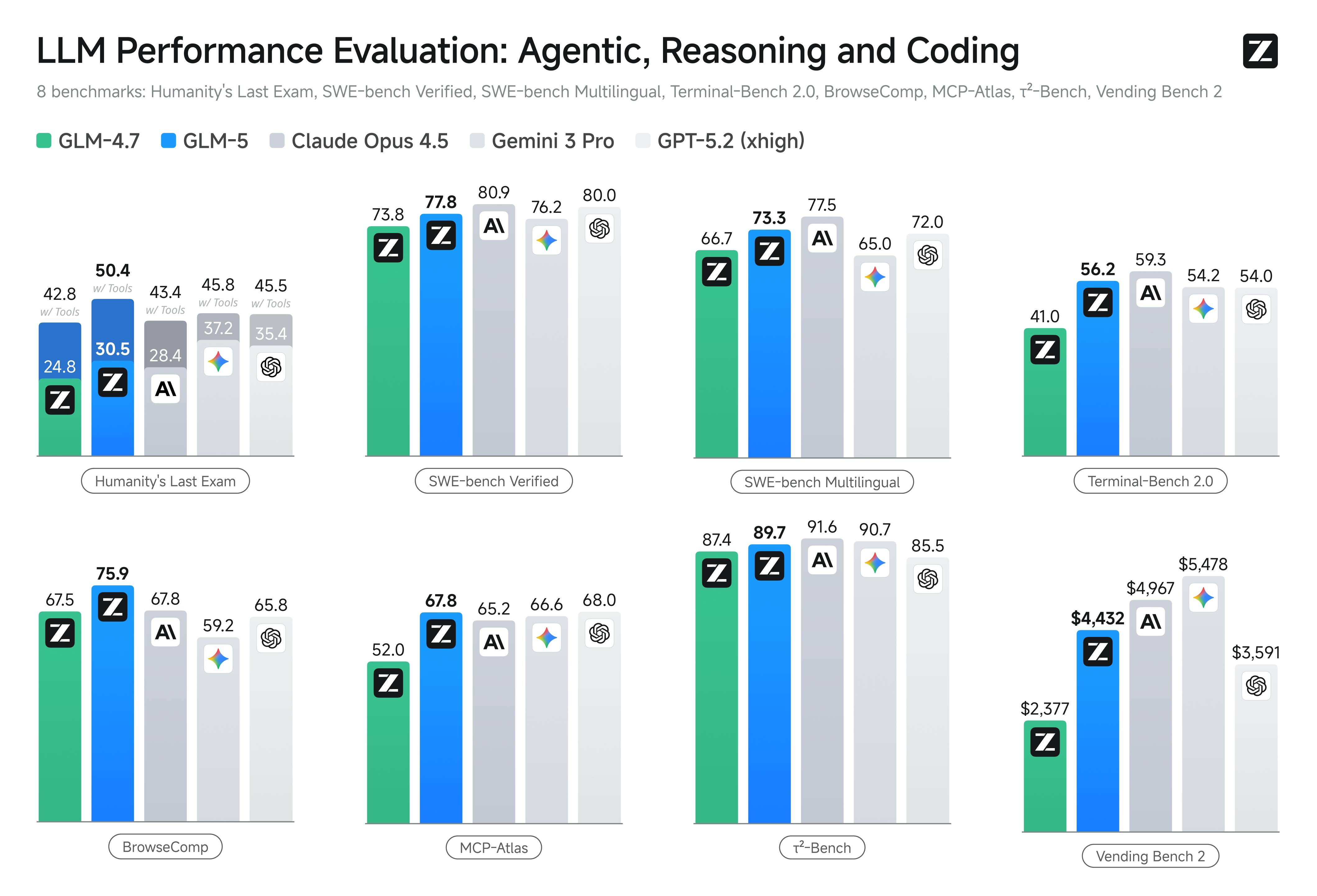

GLM-5 在编程能力上实现了对 Claude Opus 4.5 的对齐,在业内公认的主流基准测试中取得开源模型最高分数:

- SWE-bench-Verified:77.8(开源最高,超越 Gemini 3.0 Pro)

- Terminal Bench 2.0:56.2(开源最高,超越 Gemini 3.0 Pro)

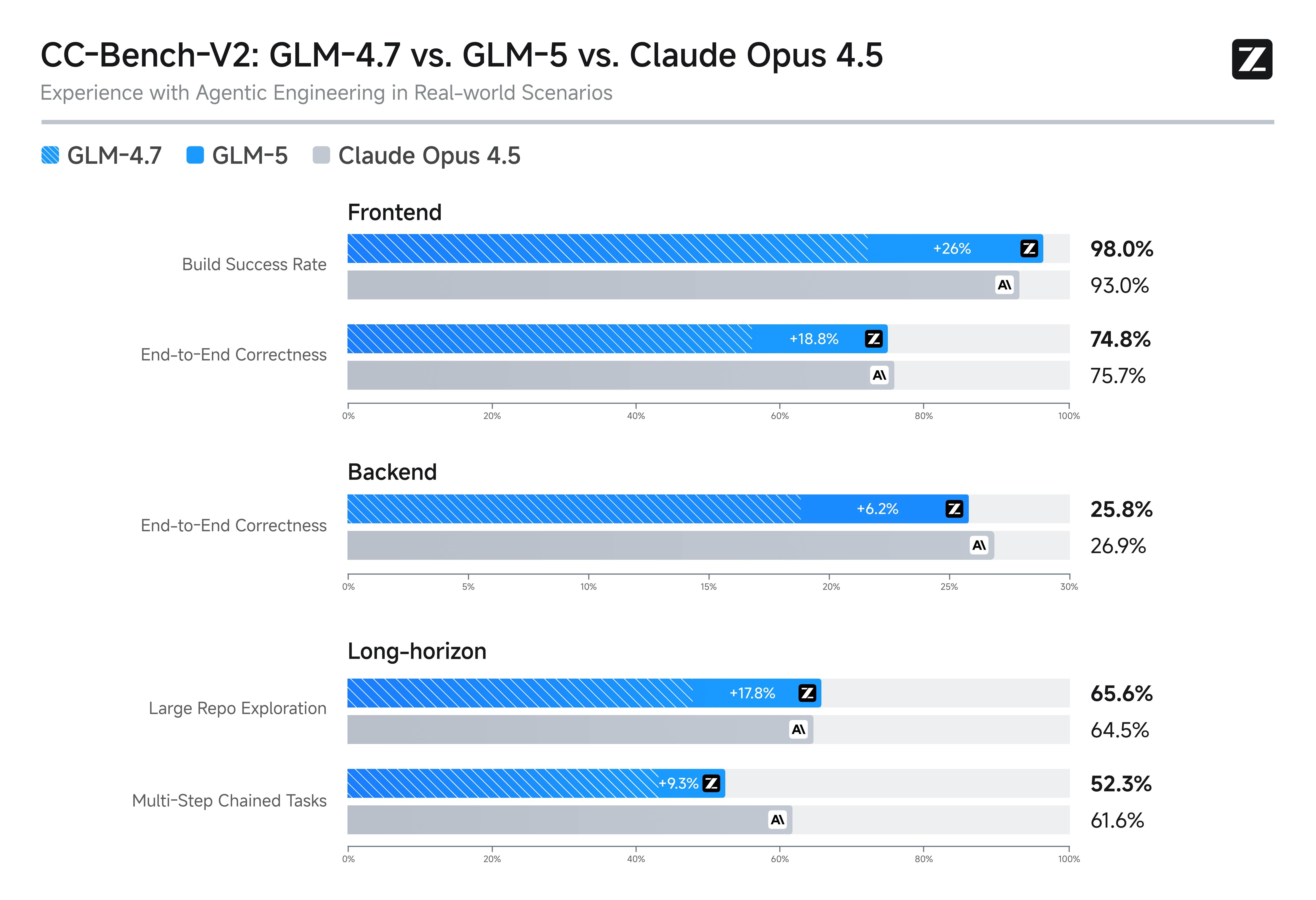

在智谱内部的 Claude Code 评估集合中,GLM-5 在前端、后端、长程任务等编程开发任务上显著超越 GLM-4.7,能够以极少的人工干预自主完成 Agentic 长程规划与执行、后端重构和深度调试等系统工程任务,使用体验逼近 Opus 4.5。

一句话总结:GLM-5 不只是能写代码,而是能写工程。

四、Agent 能力:SOTA 级长程任务执行

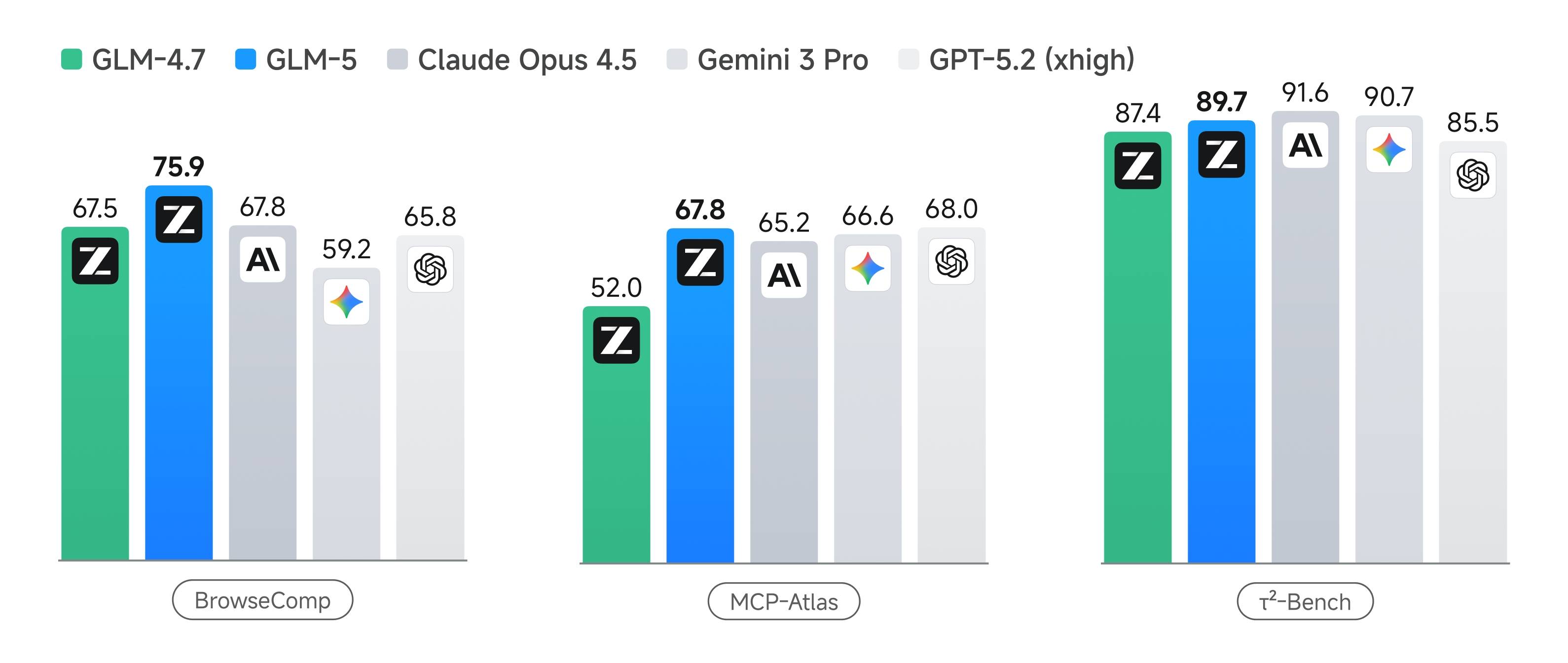

GLM-5 在 Agent 能力上实现开源 SOTA,在多个评测基准中取得开源第一:

| 评测基准 | 能力维度 | 表现 |

|---|---|---|

| BrowseComp | 联网检索与信息理解 | 开源最高 |

| MCP-Atlas | 工具调用和多步骤任务执行 | 开源最高 |

| τ²-Bench | 复杂多工具场景下的规划和执行 | 开源最高 |

这些能力是 Agentic Engineering 的核心——模型不仅要能写代码、完成工程,还要能在长程任务中保持目标一致性、进行资源管理、处理多步骤依赖关系,成为真正的 Agentic Ready 基座模型。

五、全面的能力矩阵

GLM-5 支持一系列丰富的模型能力:

| 能力 | 说明 |

|---|---|

| 思考模式 | 提供多种思考模式,覆盖不同复杂度任务 |

| 流式输出 | 支持实时流式响应,提升交互体验 |

| Function Call | 强大的外部工具调用能力 |

| MCP | 灵活调用外部 MCP 工具与数据源 |

| 上下文缓存 | 智能缓存机制,优化长对话性能 |

| 结构化输出 | 支持 JSON 等格式,便于系统集成 |

| GLM in Excel | 适配 Excel 官方 AI 插件,赋能表格工作流 |

六、推荐使用场景

Agentic Coding — 自然语言到可运行代码,覆盖前后端与数据处理,显著缩短从需求到产物的迭代周期。

智能体任务 — 从理解、规划到执行与自检的全流程智能体任务,实现"一句话输入到完整交付物"。

办公场景 — 跨阶段、多步骤、强逻辑关联的复杂办公任务,确保指令遵循度与目标一致性。

角色扮演 — 精准理解并持续保持角色设定,自然、可演进的高沉浸式角色扮演体验。

剧本/分镜脚本生成 — 长文本一致性与复杂人物塑造大幅增强,可直接进入制作流程。

翻译 — 语义、术语与表达的全面对齐,正式文本准确转换为符合目标语言表达习惯的专业译文。

文本数据提取 — 从合同、公告、财报等复杂文本中精准抽取关键字段与逻辑关系。

信息质检 — 精准识别客服工单等复杂文本中的关键信息,自动完成质检与风险识别。

七、与 GLM-4 系列的关键对比

| 指标 | GLM-4 系列 | GLM-5 |

|---|---|---|

| 参数规模 | 355B(激活 32B) | 744B(激活 40B) |

| 预训练数据 | 23T | 28.5T |

| 上下文窗口 | — | 200K |

| 最大输出 | — | 128K |

| SWE-bench-Verified | — | 77.8(开源最高) |

| Terminal Bench 2.0 | — | 56.2(开源最高) |

| 强化学习框架 | — | Slime 异步 RL |

| 稀疏注意力 | 无 | DeepSeek Sparse Attention |

写在最后

GLM-5 的发布,标志着国产大模型在 Coding 和 Agent 两大核心能力上迈入了新的阶段。

从参数规模的扩展到训练方法的创新,从编程能力对齐 Claude Opus 4.5 到 Agent 能力全面开源 SOTA,智谱正在用实力证明:开源生态同样能跑出世界级的 Agentic 基座模型。

对于开发者而言,GLM-5 的到来意味着更强大的 AI 编程伙伴和更可靠的智能体基座。无论你是在构建 AI 应用、搭建自动化工作流,还是探索 Agentic Engineering 的前沿,GLM-5 都值得一试。

相关链接:

数据来源:智谱AI开放文档,图片来自官方公开资料。